ホームページの原稿をAIで作成する機会が増えていますが、そこで注意したいのがハルシネーションです。事実と異なる情報をAIがもっともらしく出力してしまう現象で、気づかずに掲載するとSEO評価の低下や訪問者からの信頼を損なう原因になります。

この記事では、ハルシネーションが起こる原因と、AIで原稿を書く前に知っておきたい対策を解説します。

ハルシネーションとは

ハルシネーションとは、本来は幻覚や錯覚を意味する言葉で、英語のhallucinationに由来しています。近年はAIの分野でも使われるようになり、生成AIが事実と異なる情報をあたかも正しいかのように出力してしまう現象を指します。

たとえば、実在しない人物や商品を紹介したり、根拠のない説明をそれらしく提示したりするケースです。これはAIが与えられた学習データの中から、もっともらしい回答を組み立てる仕組みで動いているために起こります。

一見すると自然な文章として表示されるため、誤りに気づかないまま情報を公開してしまう危険性があります。ホームページの原稿作成でAIを使う場面が増えた今、ハルシネーションを正しく理解しておくことが欠かせません。

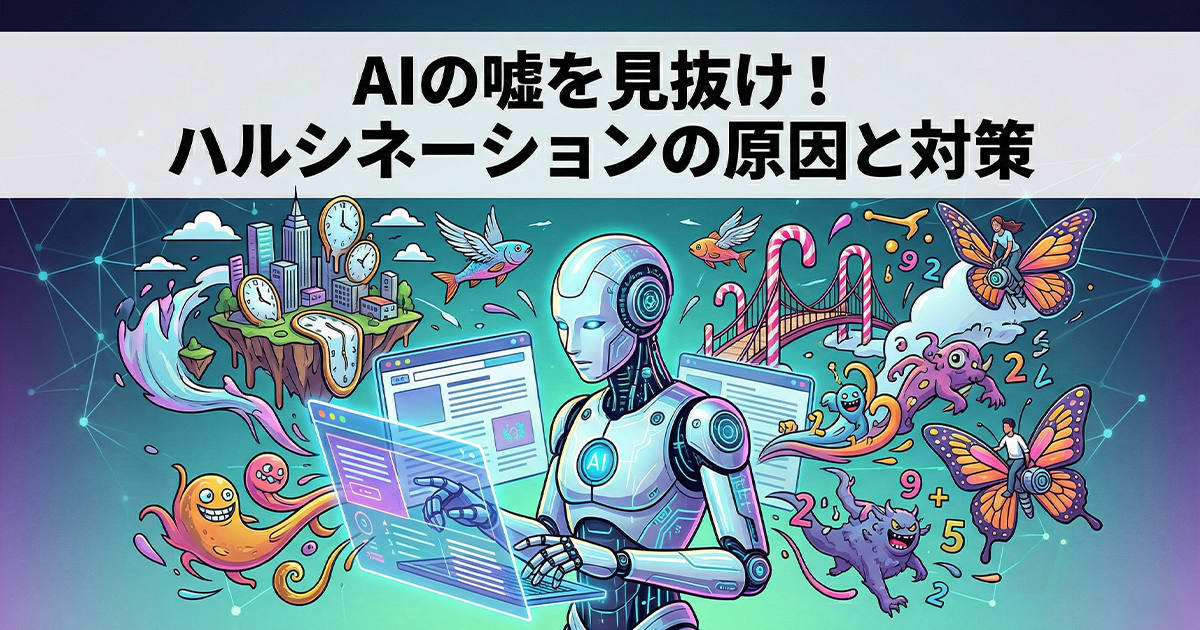

ホームページの原稿にハルシネーションが含まれるデメリット

ホームページの原稿にハルシネーションが含まれると、ホームページにさまざまな悪影響を与えます。ここでは、特に注意しておきたい2つのデメリットについて解説します。

SEO効果が低下する

Googleは検索結果の品質を保つため、正確性や信頼性の高い情報を評価する仕組みを採用しています。ハルシネーションによって事実と異なる内容が原稿に含まれていると、検索エンジンから低品質なコンテンツと判断され、掲載順位が上がりにくくなります。

特に医療や法律、金融など専門性が求められる分野では、誤情報の混入は大きなマイナス評価につながります。また、一度低品質と判断されたページが増えると、サイト全体のSEO評価まで下がってしまう可能性もあります。

AIで作成した原稿をそのまま公開することは、SEO効果を下げる原因になるため注意が必要です。

訪問者からの信頼が損なわれる

ホームページは、会社やお店の信頼性を伝える大切な場所です。掲載している情報に誤りが含まれていると、訪問者は会社の姿勢そのものに不安を感じ、問い合わせや購入につながりにくくなります。

特に中小企業や個人商店の場合、ホームページの内容が第一印象を大きく左右します。ハルシネーションによる誤情報が一度でも見つかれば、訪問者の信頼を取り戻すのは簡単ではありません。さらに、誤った情報がSNSなどで拡散されれば、会社の評判そのものに傷がつく恐れもあります。

ホームページの原稿には、正確で信頼できる情報のみを掲載することが欠かせません。

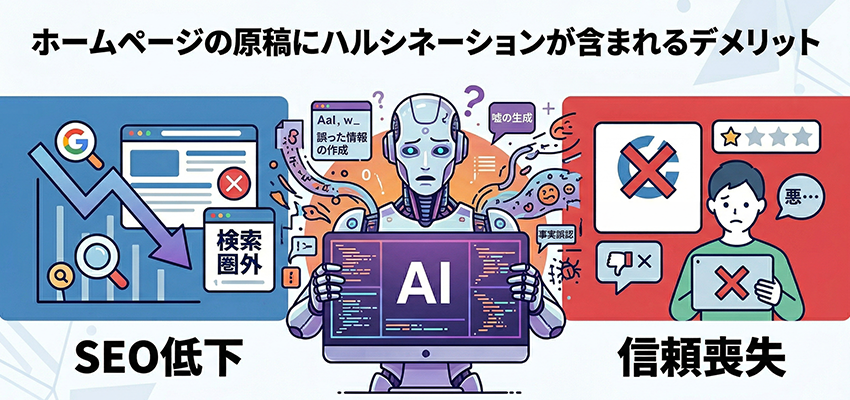

ハルシネーションが起こる原因

生成AIが便利に使われる一方で、ハルシネーションが発生する仕組みには共通する要因があります。ここでは、AIが事実と異なる情報を出力してしまう主な原因を4つ解説します。

学習データに含まれる誤情報や偏り

生成AIは、インターネット上の膨大なテキストをもとに学習しています。その中には、誤った情報や古いデータ、特定の立場に偏った内容が含まれていることも少なくありません。

AIはこうしたデータも統計的に処理して回答を組み立てるため、見た目は自然でも事実と異なる内容を出力してしまうことがあります。また、ある分野や地域の情報ばかりが多く含まれていると、その影響を受けた偏った表現を繰り返す傾向もあります。

学習データの質や偏りはAIの仕組み上避けにくく、ハルシネーションが起こる大きな原因のひとつです。

文脈理解や推論の限界

生成AIは自然な文章を作ることに優れていますが、本当の意味で文脈や論理を理解しているわけではありません。

過去の単語の並びから次に続く言葉を予測する仕組みで動いているため、整った文章に見えても、内容に矛盾や誤りが含まれている場合があります。特に因果関係が複雑なテーマや、前提条件が必要な話題では、AIが意味を正確に把握できず、あいまいな推論で回答を作りがちです。人間なら明らかに気づく誤りでも、AIには自然な文章として見えてしまいます。

こうした文脈理解や推論の限界も、ハルシネーションを引き起こす要因です。

未学習の情報への無理な回答

AIは学習した時点までのデータをもとに回答を作るため、学習していない新しい情報や、ほとんど情報が残されていないニッチな話題には正しく答えられません。

ところがAIはそのことを明確に伝えず、知っている情報を組み合わせてそれらしい回答を作り出してしまう傾向があります。その結果、実在しない人物や商品、出来事を事実のように語ってしまうことがあります。特に最新ニュースや専門性の高い分野では、情報のアップデートが追いついておらず、このリスクが高くなります。

未学習の情報に無理に答えようとする仕組みも、ハルシネーションの主な原因のひとつです。

曖昧な質問や指示による誤解

AIへの入力が不明確だったり、評価や主観を含む質問だったりすると、AIは意図を正しく読み取れず、ハルシネーションを起こしやすくなります。

たとえば、ある商品が本当に良いものなのかといった問いかけには、AIが裏付けのない理由を作り上げて答えてしまうことがあります。これは、AIが質問の背景や細かいニュアンスまで深く理解できず、文脈を補うように予測で回答を組み立てるためです。また、条件や制限を伝えていないプロンプトも、解釈違いによる誤情報の原因になります。

曖昧な指示は、誤った方向の出力を招く大きな要因です。

ハルシネーションを防ぐ対策

ハルシネーションを完全になくすことは難しいものの、使い方を工夫すればリスクは大きく抑えられます。ここでは、ホームページの原稿作成で役立つ対策を紹介します。

参考資料を前もって提供する

AIに原稿を書かせる前に、信頼できる参考資料を渡しておくことは、ハルシネーション対策として非常に効果的です。

自社のサービス資料や公式データ、過去の原稿などをプロンプトに含めておけば、AIは与えられた情報をもとに回答を組み立てるため、憶測で誤った内容を作るリスクが下がります。特にホームページの原稿では、会社概要や商品の仕様、価格など正確性が求められる情報が多く含まれます。こうした部分をAI任せにせず、元になる資料を事前に提供することで、事実に即した文章を引き出しやすくなります。

参考資料の有無は、原稿の精度を大きく左右する要素です。

回答前にWeb検索をさせる

最近の生成AIには、回答を作る前にWeb検索を行う機能が備わっているものが増えています。

この機能を活用すれば、AIは学習データだけに頼らず、最新の情報を参照したうえで回答を組み立てられるため、ハルシネーションのリスクを大きく減らせます。特に、制度や価格、最新のトレンドなど情報の鮮度が重要なテーマでは、Web検索を指示することで信頼性の高い内容を引き出しやすくなります。プロンプトに「最新情報を検索してから回答してください」と一言添えるだけでも効果的です。

学習範囲外の情報を補う仕組みとして、積極的に活用したい対策です。

壁打ちをしてから原稿を作成してもらう

いきなりAIに原稿を書かせると、文脈がずれたり、意図とは違う方向に内容が膨らんだりしがちです。

そこで有効なのが、本文を書かせる前にAIと壁打ちをして、方向性や構成を固めるやり方です。たとえば、誰に向けた内容なのか、どんな悩みを解決するのか、どの情報を盛り込むのかをAIと対話しながら整理しておけば、前提がずれることなく原稿を作れます。また、構成段階で内容を確認できるため、明らかな誤りや不自然な情報が混ざった場合にも早い段階で気づけます。

いきなり本文を作らせず、対話を挟む流れはハルシネーション対策として有効です。

論理的で端的なプロンプトを作成する

AIから正確な回答を引き出すには、プロンプトの質が欠かせません。

曖昧な表現や漠然とした質問は、AIが意図を誤って解釈し、ハルシネーションを起こす原因になります。たとえば、「サービスについて教えて」といった指示ではなく、「サービスの特徴と料金を300文字以内で簡潔に説明してください」のように、求める内容や形式、文字数を明確に伝えることが大切です。また、一度に多くのことを詰め込まず、不要な前置きを省いて要点だけを伝えることで、AIが指示を正確に読み取りやすくなります。

論理的で端的なプロンプトを組み立てることは、誤情報を防ぐための基本的な対策です。

ファクトチェックで誤情報を防ぐ

AIが作った原稿は読みやすく整っているため、一見すると正しい情報に見えてしまいます。

しかし、文脈や事実に合わない内容が含まれているケースもあるため、最後は人の目によるファクトチェックが欠かせません。出力された内容が公的機関のデータや信頼できる情報源と一致しているかを確認し、少しでも疑わしい部分があれば必ず裏付けをとるべきです。特に、数字や固有名詞、実績に関する記述は誤りが起きやすいので注意が必要です。

ホームページに掲載する原稿は会社の顔になるため、AIの出力をそのまま使わず、必ず人の手で最終確認を行う体制を整えることが重要です。

まとめ

ハルシネーションは、生成AIが事実と異なる情報をもっともらしく出力してしまう現象で、ホームページの原稿作成では特に注意が必要です。

誤った情報を掲載してしまうと、SEO評価の低下や訪問者からの信頼の損失につながり、会社やお店の印象そのものに悪影響を与えます。ハルシネーションが起こる背景には、学習データの偏りや文脈理解の限界、未学習の情報への無理な回答、曖昧なプロンプトなど複数の原因があります。これらを踏まえ、参考資料の提供やWeb検索の活用、壁打ちによる方向性の調整、論理的で端的なプロンプト、最後のファクトチェックといった対策を組み合わせることで、リスクは大きく抑えられます。

AIの便利さを活かしながら、正確な情報発信を続けるために、人の目による確認を欠かさない姿勢が大切です。